KI im GEG-Kontext

RAG statt Raten: Auditierbarkeit als Schlüsselkompetenz

Text: Luca Akyildiz | Foto (Header): © Sopa – stock.adobe.com

Wenn KI im GEG-Kontext nicht nur Wissen vermittelt, sondern als Arbeitsgrundlage in Beratung und Planung dient, verändern sich die Anforderungen an die Antwortqualität. Neben fachlicher Plausibilität rücken Prüfbarkeit, Quellenbindung und Zitierfähigkeit in den Mittelpunkt. Ein Vergleichstest mit 27 FAQ-Fragen untersucht, wie sich Allround-Modelle und ein quellengebundenes RAG-Setup im Hinblick auf Auditierbarkeit unterscheiden – und welche Systemlogik im Norm- und Rechtskontext belastbare Ergebnisse liefert.

Auszug aus:

GEG Baupraxis

Fachmagazin für energieeffiziente und ressourcenschonende Neu- und Bestandsbauten

Ausgabe März / April 2026

Jetzt Leser/-in werden

INHALTE DES BEITRAGS

Auditierbarkeit als Qualitätskriterium im GEG-Kontext

RAG als Sicherheitsmechanismus: Drei Schritte statt „Magie“

Praxischeck: plausibel vs. auditfähig

Prüfgrundlage: FAQ-Fragen als Härtetest

Prompt-Setup: Base-Prompt + FAQ-Frage

Bewertungslogik: Nicht „klingt gut“, sondern „ist prüfbar“

Ergebnisse des Vergleichstests (27 FAQ-Fragen)

Typische Fehlerbilder im Test

Folgen für Praxis, Produktlogik und Weiterbildung

Fazit

Ausblick: Vom RAG-Prototyp zur Brancheninfrastruktur

In den bisherigen Teilen haben wir gezeigt, warum Wissensschulden und Regulierungsdynamik die Weiterbildung unter Hochdruck setzen – und wie KI als Curriculum- Crawler bzw. „Wissensbagger“ Wissen aus Normen und Dokumenten hebbar macht.

Im vierten Teil wechseln wir bewusst die Flughöhe: vom Lernen in die haftungsrelevante Praxis. Denn sobald KI nicht nur Inhalte erklärt, sondern Entscheidungen vorbereitet (z. B. Fristen, Pflichten, Ausnahmen im GEG), zählt nicht mehr Plausibilität – sondern Prüfbarkeit. Genau hier wird RAG (Retrieval-Augmented Generation) zur Sicherheitsarchitektur: Die KI darf nicht raten, sie muss belegen.

„RAG ist die Brücke vom KI-gestützten Lernen zur auditierbaren Fachauskunft.“

Energieberatung ist eine Praxis unter Regulierungsdruck: Pflichten, Übergänge, Ausnahmen, Fristen. Wer hier falsch zitiert oder Fassungen vermischt, produziert keine kleine Ungenauigkeit, sondern ein Risiko. Deshalb müssen KI-Antworten im GEG-Kontext auditierbar sein – und genau dafür ist Retrieval-Augmented Generation gebaut.

Auditierbarkeit als Qualitätskriterium im GEG-Kontext

Im GEG-Kontext sind Antworten nicht nur Information, sondern potenziell Entscheidungsgrundlagen. Das verändert den Qualitätsmaßstab fundamental: Eine Antwort ist nur dann brauchbar, wenn sie (a) in der richtigen Rechtsquelle verankert ist, (b) den richtigen Textstand trifft und (c) so zitiert, dass eine Fachperson die Fundstelle in Sekunden prüfen kann.

„Auditierbar“ bedeutet deshalb nicht „mit Quellen irgendwie dekoriert“, sondern: konkret nachprüfbar (Paragraph/ Absatz, definierter Abschnitt, eindeutige Bezugnahme auf den Text).

In der Praxis scheitern allgemeine KI-Modelle weniger an Sprache oder Struktur – sondern daran, dass sie Plausibilität oft höher gewichten als Nachprüfbarkeit: Sie liefern oft eine „vernünftig klingende“ Antwort, auch wenn die Basis unklar ist. Das ist im Alltag verführerisch, im Norm- und Rechtskontext jedoch riskant: Ein erfundener Paragraph oder eine vermischte Übergangsregel ist kein Schönheitsfehler, sondern ein potenzieller Fehler im Prozess.

RAG als Sicherheitsmechanismus: Drei Schritte statt „Magie“

RAG setzt genau an dieser Stelle an – nicht als Buzzword, sondern als Prozessdisziplin. Entscheidend ist: Ein klassisches LLM kann „wissen“ oder „glauben“ – eine RAG-Engine muss belegen. Damit verschiebt sich die Rolle der KI: vom „kommunikativen Assistenten“ hin zum auditfähigen Zitationssystem mit Erklärfunktion.

Wichtig ist dabei: Eine RAG-Engine ist kein Standardprodukt, das man „einfach einschaltet“. Sie muss für den konkreten Rechts- und Anwendungskontext entwickelt und betrieben werden: mit definiertem Quellenkorpus, Versionierung, Retrieval-Logik, Zitierformaten und klaren Regeln für Unsicherheit. Erst diese Engineering-Arbeit macht aus einem Sprachmodell ein auditfähiges Fachsystem.

Praxischeck: plausibel vs. auditfähig

Um den Unterschied zwischen plausiblen und auditfähigen Antworten nicht nur theoretisch zu erklären, sondern unter realistischen Bedingungen zu prüfen, haben wir einen Vergleichstest durchgeführt. Als Prüfmaterial dienten Fragen aus offiziellen FAQ-Dokumenten [1]. Die Fragen wurden unter identischen Bedingungen an zwei aktuelle Allround-Modelle von OpenAI gestellt (GPT-4o und GPT-5.2).

Zusätzlich wurden die Fragen an ein quellengebundenes RAG-Setup, das Antworten ausschließlich auf Basis der hinterlegten Quelle formulieren darf, gerichtet. Der Zweck dieses Tests ist nicht, „die beste KI“ zu küren. Entscheidend ist eine fachliche Beobachtung: Welche Systemlogik erzeugt Antworten, die im Norm- und Rechtskontext belastbar weiterverarbeitet werden können?

Zugegeben: Dieser Vergleich ist unfair. Wir lassen ein Modell mit offenem Gesetzbuch (RAG) gegen eines antreten, das aus dem Gedächtnis zitieren muss. Aber genau das ist der Punkt: Niemand würde von einem menschlichen Energieberater verlangen, das GEG auswendig zu kennen. Warum tun wir es bei der KI? Der Test beweist nicht, dass das Modell dumm ist, sondern dass der Arbeitsprozess ohne RAG fahrlässig ist.

Hinweis zur Testumgebung

Die quellengebundene RAG-Umgebung wurde von GreenArt bereitgestellt, um den Vergleich unter standardisierten Bedingungen durchführen zu können (gleiche Fragen, gleicher Base-Prompt, einheitliches Output-Format). Die Kernaussagen des Beitrags bleiben bewusst modell- und anbieterunabhängig: Entscheidend ist nicht „wer“, sondern ob ein System Antworten belegbar und prüfbar an die Quelle koppelt.

Prüfgrundlage: FAQ-Fragen als Härtetest

FAQ-Dokumente haben eine besondere Stellung in der Praxis: Sie übersetzen komplexe Regelungslogik in typische Anwendungsfragen und spiegeln eine behördlich geprägte Auslegungssicht. Damit eignen sie sich als Testkorpus, weil sie genau jene Fragen enthalten, die in Beratungsgesprächen, Planung und Eigentümerkommunikation täglich auftreten: Übergänge, Abgrenzungen, Ausnahmen, Fristen.

Gleichzeitig sind FAQ-Quellen bewusst begrenzt: Sie bilden nicht automatisch alle angrenzenden Regelwerke ab (z. B. Förderprogramme, Richtlinien, Merkblätter). Diese Begrenzung ist kein Nachteil, sondern ein wichtiger Teil des Tests – denn sie zwingt Systeme dazu, sauber zu unterscheiden, ob eine Frage durch die Quelle tatsächlich getragen wird oder nicht.

Warum im Vergleich auch GPT-4o enthalten ist

GPT-4o ist nicht „das neueste Modell“, aber für viele Organisationen weiterhin der praktische Standard: Es ist breit verfügbar, stabil in der Anwendung und in vielen Workflows bereits etabliert. Für einen Fairness-Test im Normkontext ist genau das relevant: Wir wollen nicht nur „State of the Art“ messen, sondern das, was in der Praxis tatsächlich eingesetzt wird.

Zudem wirkt GPT-4o als Baseline: Wenn ein quellengebundenes Setup selbst gegenüber einem verbreiteten Allround-Modell messbar bessere Auditfähigkeit zeigt, ist der Befund robust – unabhängig davon, welches neue Modell als nächstes erscheint.

Base-Prompt:

Du bist ein fachlicher Assistent für das Gebäudeenergiegesetz (GEG). Gib ausschließlich auditierbare Antworten mit vollständiger Nachvollziehbarkeit.

STRUKTUR JEDER ANTWORT (zwingend einhalten):

1. ANTWORT: Kurze Kernaussage (2-4 Bulletpoints)

2. RECHTSGRUNDLAGE: Exakte GEG-Paragrafen/Artikel mit Verweis (§ X Abs. Y GEG)

3. BEGRÜNDUNG: Logische Herleitung der Antwort aus den Rechtsgrundlagen

4. SICHERHEITSGRAD: Explizite Bewertung (Sicher/Wahrscheinlich/Unsicher/Unbekannt)

5. PRÜFHINWEISE: Konkrete Schritte zur Verifikation der Antwort

Bei Unsicherheit: Benenne explizit fehlende Informationen und empfehle Expertenberatung. Trenne stets Fakten von Interpretationen. Alle Aussagen müssen durch GEG-Textstellen belegbar sein.

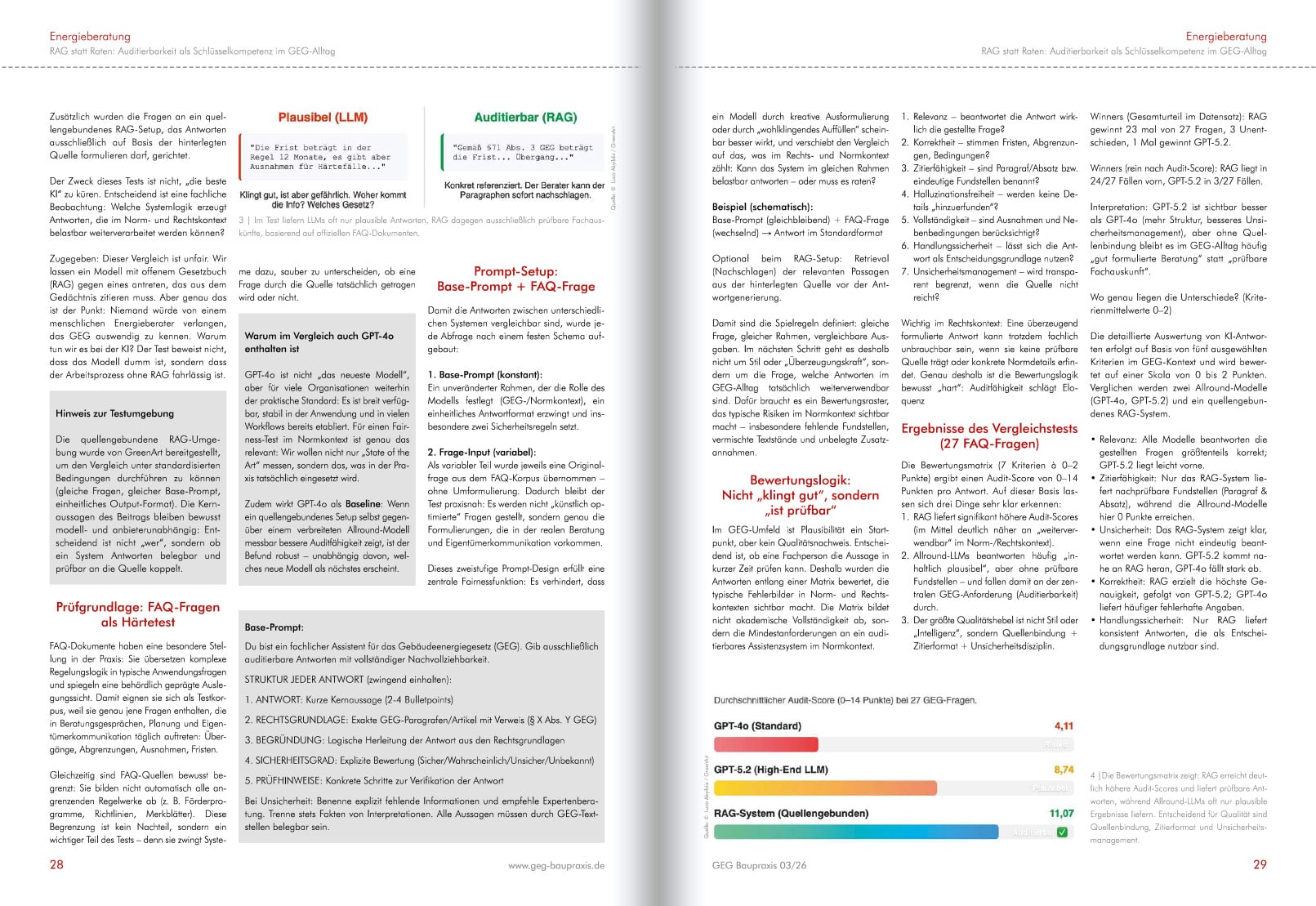

Prompt-Setup: Base-Prompt + FAQ-Frage

Damit die Antworten zwischen unterschiedlichen Systemen vergleichbar sind, wurde jede Abfrage nach einem festen Schema aufgebaut:

1. Base-Prompt (konstant):

Ein unveränderter Rahmen, der die Rolle des Modells festlegt (GEG-/Normkontext), ein einheitliches Antwortformat erzwingt und insbesondere zwei Sicherheitsregeln setzt.

2. Frage-Input (variabel):

Als variabler Teil wurde jeweils eine Originalfrage aus dem FAQ-Korpus übernommen – ohne Umformulierung. Dadurch bleibt der Test praxisnah: Es werden nicht „künstlich optimierte“ Fragen gestellt, sondern genau die Formulierungen, die in der realen Beratung und Eigentümerkommunikation vorkommen.

Dieses zweistufige Prompt-Design erfüllt eine zentrale Fairnessfunktion: Es verhindert, dass ein Modell durch kreative Ausformulierung oder durch „wohlklingendes Auffüllen“ scheinbar besser wirkt, und verschiebt den Vergleich auf das, was im Rechts- und Normkontext zählt: Kann das System im gleichen Rahmen belastbar antworten – oder muss es raten?

Beispiel (schematisch):

Base-Prompt (gleichbleibend) + FAQ-Frage (wechselnd) → Antwort im Standardformat

Optional beim RAG-Setup: Retrieval (Nachschlagen) der relevanten Passagen aus der hinterlegten Quelle vor der Antwortgenerierung.

Damit sind die Spielregeln definiert: gleiche Frage, gleicher Rahmen, vergleichbare Ausgaben. Im nächsten Schritt geht es deshalb nicht um Stil oder „Überzeugungskraft“, sondern um die Frage, welche Antworten im GEG-Alltag tatsächlich weiterverwendbar sind. Dafür braucht es ein Bewertungsraster, das typische Risiken im Normkontext sichtbar macht – insbesondere fehlende Fundstellen, vermischte Textstände und unbelegte Zusatzannahmen.

Bewertungslogik: Nicht „klingt gut“, sondern „ist prüfbar“

Im GEG-Umfeld ist Plausibilität ein Startpunkt, aber kein Qualitätsnachweis. Entscheidend ist, ob eine Fachperson die Aussage in kurzer Zeit prüfen kann. Deshalb wurden die Antworten entlang einer Matrix bewertet, die typische Fehlerbilder in Norm- und Rechtskontexten sichtbar macht. Die Matrix bildet nicht akademische Vollständigkeit ab, sondern die Mindestanforderungen an ein auditierbares Assistenzsystem im Normkontext.

1. Relevanz – beantwortet die Antwort wirklich die gestellte Frage?

2. Korrektheit – stimmen Fristen, Abgrenzungen, Bedingungen?

3. Zitierfähigkeit – sind Paragraf/Absatz bzw. eindeutige Fundstellen benannt?

4. Halluzinationsfreiheit – werden keine Details „hinzuerfunden“?

5. Vollständigkeit – sind Ausnahmen und Nebenbedingungen berücksichtigt?

6. Handlungssicherheit – lässt sich die Antwort als Entscheidungsgrundlage nutzen?

7. Unsicherheitsmanagement – wird transparent begrenzt, wenn die Quelle nicht reicht?

Wichtig im Rechtskontext: Eine überzeugend formulierte Antwort kann trotzdem fachlich unbrauchbar sein, wenn sie keine prüfbare Quelle trägt oder konkrete Normdetails erfindet. Genau deshalb ist die Bewertungslogik bewusst „hart“: Auditfähigkeit schlägt Eloquenz.

Ergebnisse des Vergleichstests (27 FAQ-Fragen)

Die Bewertungsmatrix (7 Kriterien à 0 – 2 Punkte) ergibt einen Audit-Score von 0 – 14 Punkten pro Antwort. Auf dieser Basis lassen sich drei Dinge sehr klar erkennen:

1. RAG liefert signifikant höhere Audit-Scores (im Mittel deutlich näher an „weiterverwendbar“ im Norm-/Rechtskontext).

2. Allround-LLMs beantworten häufig „inhaltlich plausibel“, aber ohne prüfbare Fundstellen – und fallen damit an der zentralen GEG-Anforderung (Auditierbarkeit) durch.

3. Der größte Qualitätshebel ist nicht Stil oder „Intelligenz“, sondern Quellenbindung + Zitierformat + Unsicherheitsdisziplin.

Winners (Gesamturteil im Datensatz): RAG gewinnt 23 mal von 27 Fragen, 3 Unentschieden, 1 Mal gewinnt GPT-5.2.

Winners (rein nach Audit-Score): RAG liegt in 24/27 Fällen vorn, GPT-5.2 in 3/27 Fällen.

Interpretation: GPT-5.2 ist sichtbar besser als GPT-4o (mehr Struktur, besseres Unsicherheitsmanagement), aber ohne Quellenbindung bleibt es im GEG-Alltag häufig „gut formulierte Beratung“ statt „prüfbare Fachauskunft“.

Wo genau liegen die Unterschiede? (Kriterienmittelwerte 0 – 2)

Die detaillierte Auswertung von KI-Antworten erfolgt auf Basis von fünf ausgewählten Kriterien im GEG-Kontext und wird bewertet auf einer Skala von 0 bis 2 Punkten. Verglichen werden zwei Allround-Modelle (GPT-4o, GPT-5.2) und ein quellengebundenes RAG-System.

– Relevanz: Alle Modelle beantworten die gestellten Fragen größtenteils korrekt; GPT-5.2 liegt leicht vorne.

– Zitierfähigkeit: Nur das RAG-System liefert nachprüfbare Fundstellen (Paragraf & Absatz), während die Allround-Modelle hier 0 Punkte erreichen.

– Unsicherheit: Das RAG-System zeigt klar, wenn eine Frage nicht eindeutig beantwortet werden kann. GPT-5.2 kommt nahe an RAG heran, GPT-4o fällt stark ab.

– Korrektheit: RAG erzielt die höchste Genauigkeit, gefolgt von GPT-5.2; GPT-4o liefert häufiger fehlerhafte Angaben.

– Handlungssicherheit: Nur RAG liefert konsistent Antworten, die als Entscheidungsgrundlage nutzbar sind.

Befund: Zitierfähigkeit entscheidet über Auditfähigkeit

– GPT-4o: 0% der Antworten mit verwertbaren Fundstellen

– GPT-5.2: 0% der Antworten mit verwertbaren Fundstellen

– RAG: 92,6% der Antworten mit mindestens einer prüfbaren Fundstelle

Konsequenz: Im Norm-/Rechtskontext ist „schön erklärt“ wertlos, wenn es nicht in Sekunden nachprüfbar ist. Ohne §/Abs./eindeutige Passage bleibt eine Antwort nicht auditfähig, selbst wenn sie plausibel klingt.

Typische Fehlerbilder im Test

Aus den Red-Flags im Datensatz lassen sich drei Muster verdichten:

A) Vermischung von Regelwerken (GEG vs. Förderung/BEG/KfW)

Ein wiederkehrender Stolperstein ist die „Förder-Überblendung“: Die Frage ist GEG-nah, aber die Antwort rutscht in Förderlogiken (BEG/KfW), teils mit unklaren Bedingungen oder impliziten Annahmen.

RAG kann hier sauber sagen: „Steht so nicht im GEG/FAQ; wenn Förderung gemeint ist, braucht es eine andere Quelle.“

LLMs liefern dagegen häufig „hilfreiche“ Zusatzinfos – genau das ist im Auditkontext riskant, weil Quelle und Geltungsbereich verschwimmen.

B) Plausibilität ersetzt Textstand/Versionierung

Bei Übergangsregeln, Fristen, Ausnahmen ist der Textstand entscheidend. Ohne harte Quellenbindung rät das Modell oft „vernünftig“.

Im GEG-Alltag ist das ein No-Go: Eine falsch zugeordnete Übergangsregel ist ein Prozessrisiko, keine sprachliche Ungenauigkeit.

C) Unsicherheit wird nicht sauber operationalisiert

GPT-5.2 ist hier deutlich besser als GPT-4o (es sagt öfter „unklar“). Aber erst RAG macht daraus ein prüfbares Arbeitsangebot: „Diese Quelle trägt das nicht; bitte X prüfen; ich kann nur Y belegen.“

Das ist „professionelle Unsicherheit“ statt „Ausweichen“.

Folgen für Praxis, Produktlogik und Weiterbildung

RAG ist im GEG-Kontext kein „Feature“, das man einem Sprachmodell einfach zuschaltet – es ist eine Sicherheitsarchitektur. Wer KI hier produktiv einsetzen will, braucht einen Betriebsmodus, der Auditierbarkeit nicht nur verspricht, sondern technisch erzwingt: ein klar definierter Quellenkorpus (welche Dokumente zählen als Wahrheit), ein sauber versionierter Textstand (welcher Stand ist aktiv), eine robuste Retrieval-Logik (wie werden relevante Passagen gefunden), ein eindeutiges Zitierformat (wie werden Fundstellen ausgegeben) sowie Regeln für Unsicherheit („wenn die Quelle nicht reicht, wird nicht geraten“). Ergänzt wird das durch Protokollierung, damit jederzeit nachvollziehbar bleibt, welche Passage zu welcher Aussage geführt hat. Ohne diese Disziplin bleibt KI ein Kommunikationswerkzeug – und produziert im Rechtskontext genau das, was man vermeiden muss: schöne, riskante Antworten.

Daraus folgt auch eine Verschiebung dessen, was wir unter „KI-Kompetenz“ verstehen. Im Normkontext entscheidet nicht Prompt-Kunst, sondern Prüfroutine. Wer KI verantwortbar nutzen will, muss Geltungsbereiche auseinanderhalten (GEG vs. Förderung vs. Richtlinien), den Textstand aktiv benennen, Fundstellen lesen und gegenprüfen können, Unsicherheit akzeptieren und sauber weiterreichen – und KI-Antworten konsequent als Vorprüfung behandeln, nicht als Entscheidung.

Fazit

Der Vergleichstest macht sichtbar, was viele in der Praxis bereits ahnen. Allround-Modelle sind beeindruckende Sprach- und Strukturmaschinen – aber im GEG-Kontext oft nicht auditfähig, weil sie ohne belastbare Fundstellen arbeiten und Plausibilität zu hoch gewichten. RAG-Systeme erzwingen eine andere Logik: belegen oder begrenzen. Genau dadurch werden sie zur Sicherheitsarchitektur, die KI-Nutzung im Rechts- und Normumfeld überhaupt erst verantwortbar macht. Zugespitzt heißt das: Im GEG-Kontext ist eine „richtige“ Antwort ohne prüfbare Fundstelle keine richtige Antwort – sondern ein Risiko mit gutem Stil.

Was ist RAG?

RAG steht für Retrieval-Augmented Generation. Dabei kombiniert ein KI-System Sprachgenerierung mit gezieltem Quellenabruf: Vor der Antwort durchsucht es einen definierten Dokumentenkorpus (z. B. Gesetze, FAQ, Richtlinien), bindet relevante Passagen ein und formuliert darauf basierend die Ausgabe – idealerweise mit konkreten Fundstellen.

Im GEG-Kontext liefert RAG im Gegensatz zu Sprachmodellen prüfbare Fachauskünfte, die bei Fristen, Übergangsregeln und Ausnahmen als belastbare Grundlage für Beratung und Planung dienen.

Methodischer Hinweis (Transparenz): Bewertet wurden 27 FAQ-Fragen. Pro Antwort wurden sieben Kriterien (0 – 2 Punkte) bewertet; daraus ergibt sich ein Audit-Score (0 – 14). Zusätzlich wurde im Datensatz ein Gesamturteil („winner“) festgehalten.

Ausblick: Vom RAG-Prototyp zur Brancheninfrastruktur

Im nächsten Schritt geht es nicht mehr darum, ob RAG im Normkontext sinnvoll ist, sondern wie man es in der Breite betreibt: mit kuratierten, versionierten Quellenbibliotheken, klaren Zuständigkeitsmodellen („wer pflegt welchen Korpus?“), standardisierten Zitier- und Auditformaten sowie Schnittstellen in Weiterbildung, Beratung und Planung. Entscheidend wird dabei die Produktlogik: KI wird nicht „noch ein Chatbot“, sondern ein prüfbares Assistenzsystem, das Prozesse beschleunigt, ohne die Verantwortung zu verschleiern. Wer diese Infrastruktur früh sauber aufsetzt, gewinnt nicht nur Effizienz – sondern v. a. etwas etwas, das im Rechts- und Normkontext knapp ist: Vertrauen durch Nachvollziehbarkeit.

Was ist RAG?

RAG steht für Retrieval-Augmented Generation. Dabei kombiniert ein KI-System Sprachgenerierung mit gezieltem Quellenabruf: Vor der Antwort durchsucht es einen definierten Dokumentenkorpus (z. B. Gesetze, FAQ, Richtlinien), bindet relevante Passagen ein und formuliert darauf basierend die Ausgabe – idealerweise mit konkreten Fundstellen.

Im GEG-Kontext liefert RAG im Gegensatz zu Sprachmodellen prüfbare Fachauskünfte, die bei Fristen, Übergangsregeln und Ausnahmen als belastbare Grundlage für Beratung und Planung dienen.

Der Autor

Luca Akyildiz leitete die Entwicklung des Modellgebäudeverfahrens für Wohngebäude an der Universität Stuttgart, das ins Gebäudeenergiegesetz 2020 integriert wurde. Zudem war er an der Software zur Validierung der DIN V 18599:2016 beteiligt. Aktuell ist er als Honorardozent an der IU Internationalen Hochschule tätig, wo er Energieberater in den Bereichen Gebäudetechnik und Smart Buildings ausbildet.